Únase a Leaders en Boston el 27 de marzo para una noche exclusiva de networking, ideas y conversación. Solicite una invitación aquí.

El famoso servicio de generación de imágenes con inteligencia artificial En pleno vuelo Ha implementado una de sus funciones más solicitadas: la capacidad de recrear personajes de manera consistente en nuevas imágenes.

Por naturaleza, esto ha sido un gran obstáculo para los generadores de imágenes de IA hasta la fecha.

Esto se debe a que la mayoría de los generadores de imágenes de IA se basan en «Modelos de difusión«, herramientas similares o basadas en el algoritmo de generación de imágenes de código abierto de Stability AI, Stable Diffusion, que funciona aproximadamente tomando el texto ingresado por el usuario e intentando reconstruir una imagen píxel por píxel que coincida con esa descripción, como hemos aprendí de experimentos similares con imágenes y etiquetas de texto en un grupo. Datos de entrenamiento enormes (y controvertidos) que comprenden millones de imágenes generadas por humanos.

Por qué las personalidades consistentes son tan poderosas (y esquivas) para la IA generativa

Sin embargo, al igual que con los grandes modelos de lenguaje basado en texto (LLM) como ChatGPT de OpenAI o el nuevo Command-R de Cohere, el problema con todas las aplicaciones de IA generativa es la inconsistencia de las respuestas: la IA genera algo nuevo para cada mensaje individual ingresado en ella. , incluso si el reclamo se repite o se utilizan algunas de las mismas palabras clave.

evento VB

Gira de impacto de la inteligencia artificial – Boston

Pide una invitación

Esto es excelente para crear contenidos completamente nuevos (en el caso de Midjourney, imágenes). Pero, ¿qué pasa si estás haciendo una película, una novela, una novela gráfica, un cómic o algún otro medio visual que te guste? Lo mismo ¿Un personaje o personajes por los que moverse y aparecer en diferentes escenas y escenarios, con diferentes expresiones faciales y accesorios?

Este escenario exacto, que suele ser necesario para la continuidad narrativa, ha sido muy difícil de lograr utilizando IA generativa, hasta ahora. Pero Midjourney ahora está trabajando en ese problema, introduciendo una nueva etiqueta, “–cref” (abreviatura de “referencia de personaje”) que los usuarios pueden agregar al final de sus indicaciones de texto en Midjourney Discord e intentará hacer coincidir la cara de un personaje. Características, tipo de cuerpo e incluso ropa de la URL que el usuario pega en la siguiente etiqueta mencionada.

A medida que la función progresa y mejora, Midjourney podría llevar más allá de ser un juego genial o una fuente de ideas a una herramienta más profesional.

Cómo utilizar la nueva función de personalidad consistente de Midjourney

La etiqueta funciona mejor con imágenes de Midjourney creadas previamente. Así, por ejemplo, el flujo de trabajo del usuario sería crear o recuperar la URL de un carácter generado previamente.

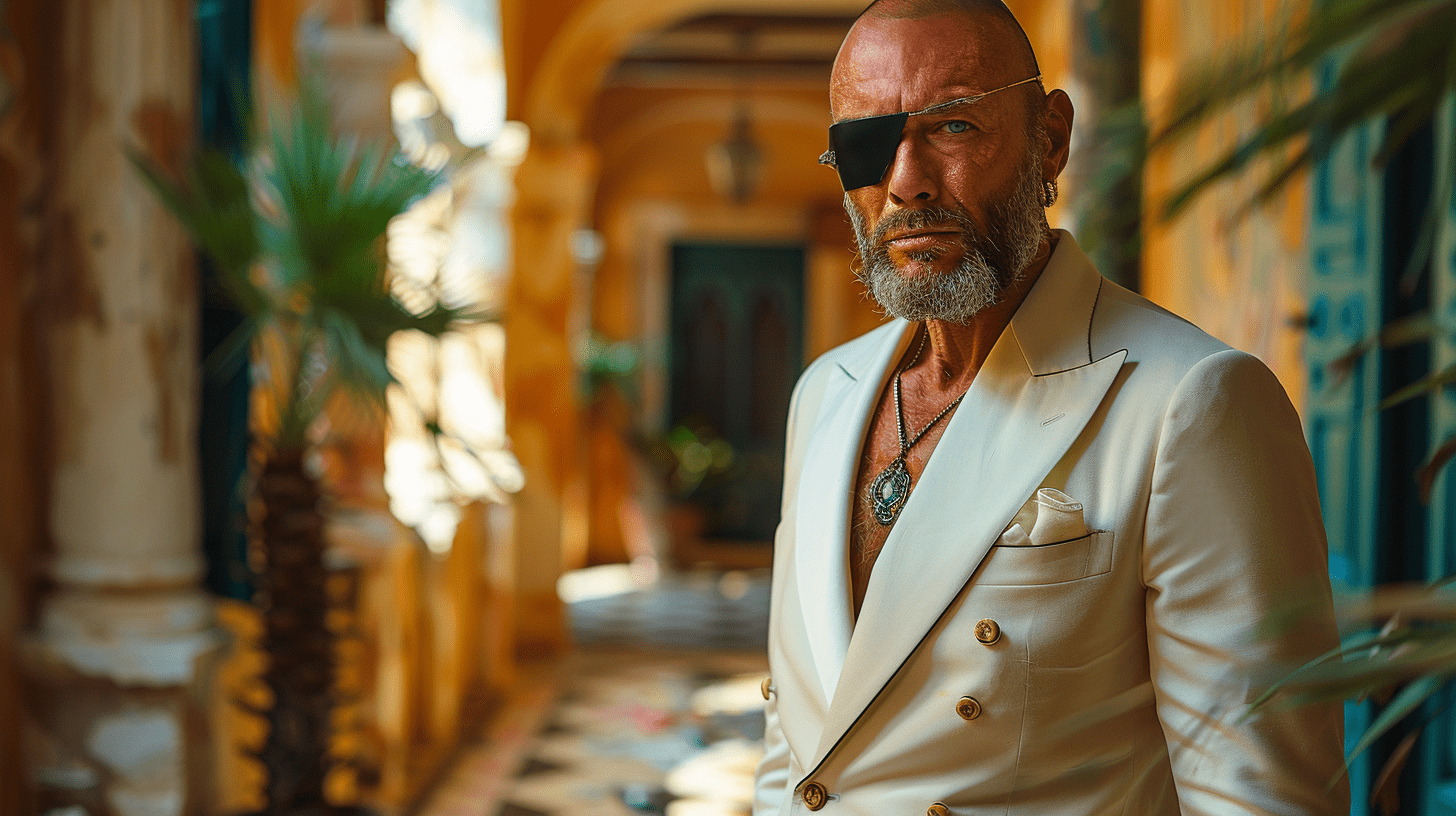

Comencemos desde cero y digamos que estamos creando un nuevo personaje con este mensaje: «Hombre calvo y musculoso con una cuenta y un parche en el ojo».

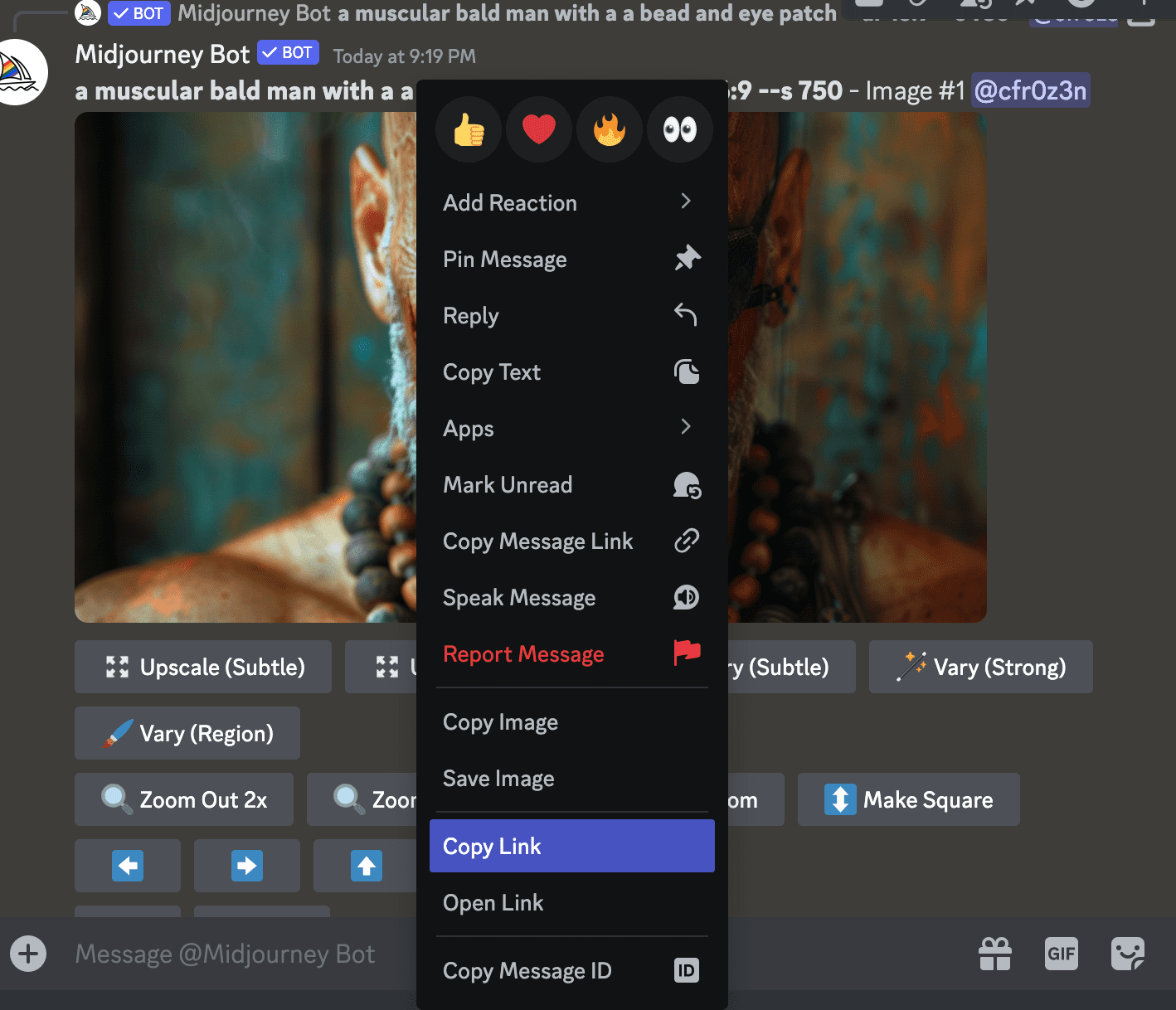

Actualizaremos la imagen que más nos guste, luego presione Control y haga clic en ella en el servidor de Midjourney Discord para encontrar la opción «Copiar enlace».

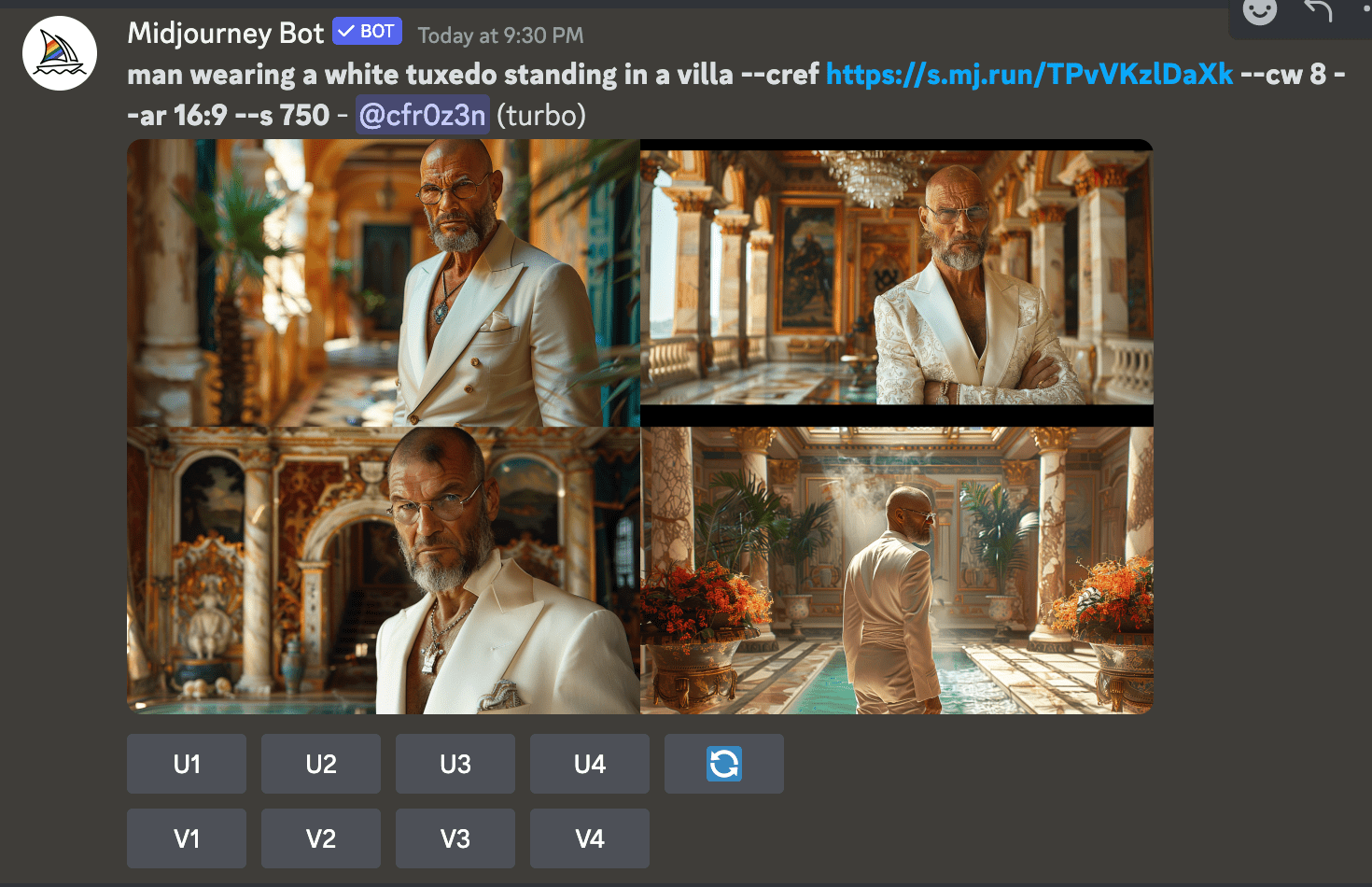

A continuación, podemos escribir un nuevo mensaje en «Use un esmoquin blanco mientras esté en una villa -cref». [URL]» y pegue la URL de la imagen que acabamos de crear, y Midjourney intentará crear el mismo carácter anterior en la configuración recién escrita.

Como verá, los resultados están lejos de coincidir con la cifra original (o incluso con nuestra afirmación original), pero ciertamente son alentadores.

Además, el usuario puede controlar hasta cierto punto el «peso» de qué tan cerca se produce la nueva imagen del carácter original aplicando el indicador «-cw» seguido de un número del 1 al 100 al final del nuevo mensaje ( después de «-cref [URL]»cadena, como esta:»-cref [URL] – CW 100″. Cuanto menor sea el número «CW», mayor será el contraste en la imagen resultante. Cuanto mayor sea el número «CW», más se acercará la nueva imagen resultante a la referencia original.

Como puede ver en nuestro ejemplo, ingresar «cw 8» muy bajo en realidad devolvió lo que queríamos: el esmoquin blanco. Aunque ahora le ha quitado el parche característico de nuestro personaje.

Bueno, no hay nada que una «área diferente» no pueda solucionar, ¿verdad?

Bueno, el parche se puso en el ojo equivocado… ¡pero llegamos allí!

También puedes combinar varios caracteres en uno usando dos etiquetas “–cref” junto con sus respectivas URL.

La función se lanzó esta noche, pero los artistas y creadores la están probando ahora. Pruébelo usted mismo si tiene Midjourney. Y lea la nota completa del fundador David Holz sobre el tema a continuación:

Hola a todos, hoy estamos probando la nueva función Referencia de personajes, que es similar a la función Referencia de patrones, excepto que en lugar de coincidir con un patrón de referencia, intenta hacer que el personaje coincida con la imagen de Referencia de personajes.

Cómo funciona

- El escribe

--cref URLDespués de que se te solicite la URL de tu foto de perfil - puedes usar

--cwPara ajustar la «fuerza» de la referencia de 100 a 0 - Fuerza 100 (

--cw 100) Predeterminado y utiliza la cara, el cabello y la ropa. - (fuertemente 0)

--cw 0) solo se centrará en la cara (bueno para cambiarse de ropa/peinado, etc.)

¿Para qué está destinado?

- Esta característica funciona mejor cuando se utilizan personajes creados a partir de imágenes de Midjourney. No está diseñado para personas/imágenes reales (y probablemente las distorsionará como lo hacen las indicaciones de imágenes normales)

- Cref funciona de manera similar a las indicaciones de imágenes normales, excepto que se «centra» en los rasgos del personaje.

- La precisión de esta técnica es limitada y no replicará exactamente hoyuelos, pecas o logotipos de camisetas.

- Cref funciona con los modelos Niji y MJ normales y también se puede combinar con

--sref

Opciones avanzadas

- Puedes usar más de una URL para mezclar información/caracteres de múltiples imágenes como esta

--cref URL1 URL2(Esto es similar a las indicaciones de múltiples imágenes o estilos)

¿Cómo funciona en Alpha Web?

- Arrastre o pegue una imagen en la barra de visualización, donde ahora contiene tres íconos. Especifique estos grupos si son un vector de imagen, una referencia de estilo o una referencia de carácter. Mayús+Seleccionar una opción para usar una imagen para múltiples categorías

Recuerde, aunque MJ V6 se encuentra en etapa alfa, otras características pueden cambiar repentinamente, pero la versión beta oficial de V6 llegará pronto. Nos encantaría compartir las opiniones de todos sobre Ideas y características y esperamos que disfrutes de esta versión anticipada y que te ayude mientras juegas en la construcción de historias y mundos.

La misión de VentureBeat Será una plaza digital para que los tomadores de decisiones técnicas adquieran conocimientos sobre tecnología empresarial transaccional y transformacional. Descubra nuestros resúmenes.